不准确"/>

不准确"/>

逐行复制大文件不准确

我正在尝试使用 node.js 从大量语料库中正确读取和写入 100 万行。 问题是我得到一个包含一百万行的输出文件,但第 1 百万行是原始文件的第 900 行。

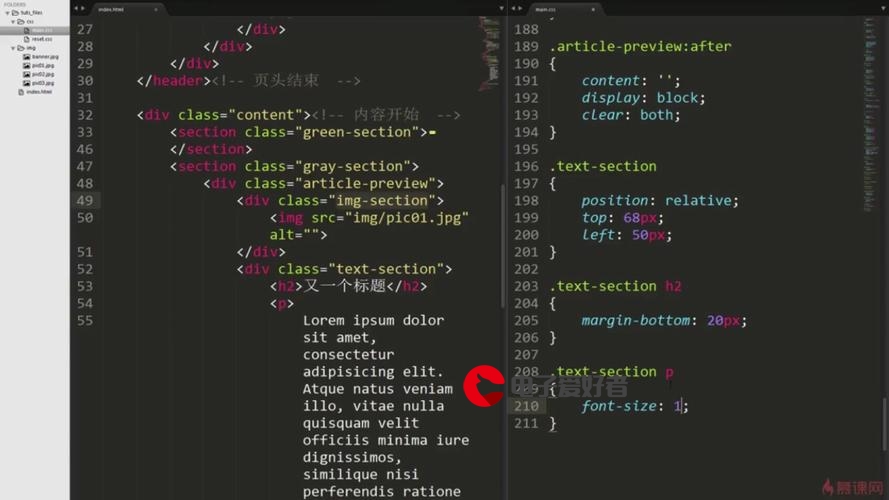

这是我用的:

fs =require("fs");

var buffer = '';

var rs1 = fs.createReadStream('00.jsonl',"ascii");

var ws = fs.createWriteStream('pile_1M.txt', {flags: 'w',encoding: 'ascii'});

var lines_num=0;

var max_read=1000000;

rs1.on('data', function(chunk) {

rs1.pause()

var lines = (buffer+chunk).split(/\r?\n/g);

for (var i = 0; i < lines.length && lines_num<max_read; ++i) {

lines_num++;

ws.write(lines[i]+"\n");}

}

if(lines_num>=max_read){

rs1.close()

console.log("close")

}

rs1.resume();

});

rs1.on('close', function () {

ws.close();

});

你的阅读不一定是整行。它们很可能不会在一行的末尾结束。

所以,你这样做:

var lines = (buffer+chunk).split(/\r?\n/g);

然后,您将这些算作整行,但拆分中的最后一行不一定是整行。

然后你这样做:

ws.write(lines[i]+"\n");

你在每个分割片的末尾添加一个

\n通常的处理方法是保存拆分的最后一块,不要将其算作一行,也不要将其写出。将其保存以添加到下一次阅读中。这样你只写出一个

\n而且,如果行边界是

\r\n\r另外,我看不到您在此代码中的何处重置

bufferbuffer在一个单独的主题上,您还应该观察流量控制:

ws.write(lines[i]+"\n");

.write()drain更多推荐

逐行复制大文件不准确

发布评论