爬虫生涯(二):爬取小姐姐的照片②(网站已停用)"/>

爬虫生涯(二):爬取小姐姐的照片②(网站已停用)"/>

从零开始的爬虫生涯(二):爬取小姐姐的照片②(网站已停用)

文章目录

- 前言

- 思路分析

- 1.页面源码分析

- 2.爬虫思路

- 爬虫代码

- 1.开发环境

- 2.代码分解

- (1).引入库

- (2)获取每个页面的地址

- (3).获取每张图片的地址

- (4).保存图片到指定文件夹

- 3.整体代码

- 爬取结果

前言

从这篇文章开始,我们将通过连续的几篇文章来爬取某妹网(url :/)的所有小姐姐照片。借这个例子我们一起学习简易的python爬虫。

相关文章请看

从零开始的爬虫生涯(一):爬取小姐姐的照片①

从零开始的爬虫生涯(三):爬取小姐姐的照片③

思路分析

1.页面源码分析

由于上次我们已经把一个页面的小姐姐图片全部爬下来了,所以现在我们只需要获取每个页面的url,然后再每个页面都爬一次就OK了

说干就干!

首先我们先查看页面源码

发现一个url,点进去看看

结果只是封面。。。再找,发现它就在刚刚的封面上面!芜湖!

观察整个页面的代码

所有页面的url就放在这些li块中

那么我们只需通过与上篇文章类似的思路取出每个页面的url就大功告成!

2.爬虫思路

直接用request取到整个网页,再用BeatutifulSoup解析网页,取出所有的页面链接,再遍历链接,按照上篇文章的方法保存图片。

爬虫代码

1.开发环境

开发环境:win10 python3.6.8

使用工具:pycharm

使用第三方库:requests、os、BeatutifulSoup

2.代码分解

(1).引入库

import requests

import os

from bs4 import BeautifulSoup

(2)获取每个页面的地址

target_url = "/"

r = requests.get(url=target_url)

html = BeautifulSoup(r.text, 'html5lib')

b2_gap = html.find('ul', class_='b2_gap')

print(str(1) + "page is OK")

img_main = b2_gap.find_all('a', class_='thumb-link')

img_main_urls = []

for img in img_main:img_main_url = img.get('href')img_main_urls.append(img_main_url)

(3).获取每张图片的地址

for j in range(len(img_main_urls) + 1):print(img_main_urls[j])r = requests.get(url=img_main_urls[j])html = BeautifulSoup(r.text, 'html5lib')entry_content = html.find('div', class_='entry-content')img_list = entry_content.find_all('img')img_urls = []num = 0name = html.find('h1').textprint(name)for img in img_list:img_url = img.get('src')result = requests.get(img_url).content

(4).保存图片到指定文件夹

path = '图片'if not os.path.exists(path):os.mkdir(path)f = open(path + '/' + name + str(num) + '.jpg', 'wb')f.write(result)num += 1print('正在下载{}第{}张图片'.format(name, num))

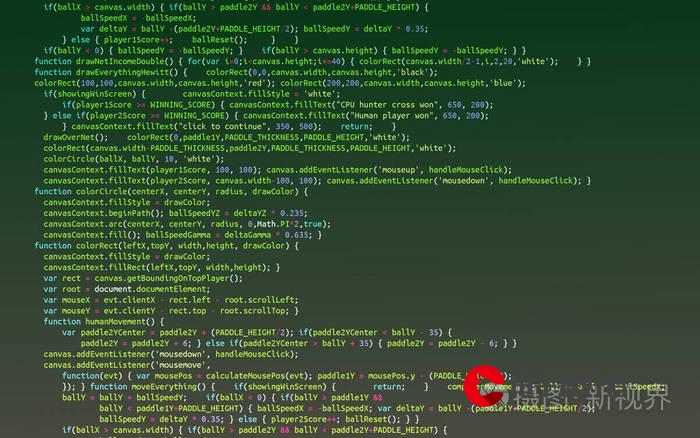

3.整体代码

import requests

import os

from bs4 import BeautifulSouptarget_url = "/"

r = requests.get(url=target_url)

html = BeautifulSoup(r.text, 'html5lib')

b2_gap = html.find('ul', class_='b2_gap')

print(str(1) + "page is OK")

img_main = b2_gap.find_all('a', class_='thumb-link')

img_main_urls = []for img in img_main:img_main_url = img.get('href')img_main_urls.append(img_main_url)for j in range(len(img_main_urls) + 1):print(img_main_urls[j])r = requests.get(url=img_main_urls[j])html = BeautifulSoup(r.text, 'html5lib')entry_content = html.find('div', class_='entry-content')img_list = entry_content.find_all('img')img_urls = []num = 0name = html.find('h1').textprint(name)for img in img_list:img_url = img.get('src')result = requests.get(img_url).contentpath = '图片'if not os.path.exists(path):os.mkdir(path)f = open(path + '/' + name + str(num) + '.jpg', 'wb')f.write(result)num += 1print('正在下载{}第{}张图片'.format(name, num))爬取结果

这次爬取只爬了自拍分项下的第一页,下一篇文章我们将爬取所有分项的所有页面,敬请期待。

更多推荐

从零开始的爬虫生涯(二):爬取小姐姐的照片②(网站已停用)

发布评论