论文阅读】Deep crisp boundaries(2017)"/>

论文阅读】Deep crisp boundaries(2017)"/>

【论文阅读】Deep crisp boundaries(2017)

原文链接

原文代码

Wang, Y., Zhao, X., & Huang, K. (2017). Deep crisp boundaries. In Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition (pp. 3892-3900).

文章目录

- 摘要

- 1.介绍

- 2. CovNet里的厚边缘

- 3. 网络结构

- 4. 结果

- 4.1消融实验

- 4.2 PR曲线

- 4.3 定量结果

- 4.4直观结果

- 4.5 maximal permissible distance d

- 小结

摘要

- 设计了一种能够输出较细边缘的边缘检测网络,该方法利用自顶向下的向后细化路径,并逐步提高特征图的分辨率以生成清晰的边缘。

- 在BSDS500上取得超过人眼的成绩,是当时SOTA的模型。

1.介绍

- 准确的边缘检测器必须在边缘的“正确性”(区分边缘和非边缘像素)和边界的“清晰性”(crispness)(精确定位边缘像素)之间取得平衡。

- 定性和定量的结果都表明,ConvNet的边缘映射是高度“正确”的,但不太“清晰”——边缘没有很好的局部化。这是因为:①在更具辨别力的顶层,特征的空间分辨率急剧降低,导致边缘输出模糊。②全卷积结构鼓励相邻像素有类似响应(由双线性插值上采样导致),因此可能无法生成薄边缘映射。

- 本文贡献:①对ConvNet中的边缘图进行了系统的研究。结果表明,ConvNet在边缘像素分类方面有很好的优势,但定位能力较差;②我们将细化方案与亚像素卷积结合起来,形成了一种新的结构,专门用于学习清晰的边缘检测器;③在BSDS500上的结果在所有匹配距离上都优于SOTA的结果。我们还表明,清晰的边缘映射可以提高光流估计和目标生成。

2. CovNet里的厚边缘

为什么HED产生较厚边缘但评价指标依旧很好呢?

标准评估迭代所有置信阈值,并使用二部图来匹配二值化边缘映射到真值边缘的距离。

匹配由最大允许距离d控制。一个未对齐的边缘像素只要它的距离最近的真值小于d,仍然被认为是正确的。

因此使用较大的d,即使边缘有轻微的移动,也可以得到一个很好的分数。

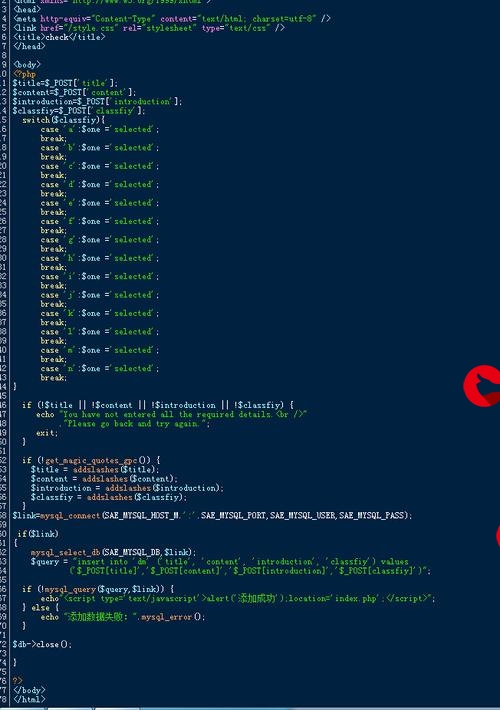

3. 网络结构

其它的都很好懂,这里唯一需要注意的是,上采样利用sub-pixel convolution,作者在文章中说这种上采样方式能更好的定位边缘位置。

那么什么是sub-pixel convolution呢?

请参考这篇文章

4. 结果

4.1消融实验

4.2 PR曲线

4.3 定量结果

4.4直观结果

4.5 maximal permissible distance d

小结

更多推荐

【论文阅读】Deep crisp boundaries(2017)

发布评论